La vie numérique des enfants regorge d’expériences positives, mais aussi de risques bien réels, dont certains apparaissent si vite que la société s’empresse de les appréhender.

Il est pourtant essentiel que nous le fassions. En comprenant les risques auxquels les enfants sont confrontés en ligne, nous pouvons développer des systèmes pour les protéger contre les dangers liés aux avancées technologiques rapides.

Depuis 2019, les initiatives de recherche méthodiques de Thorn nous ont aidés à comprendre et à suivre les comportements, les expériences et les risques des jeunes en ligne. Pilier de ces initiatives, notre rapport annuel de surveillance des jeunes présente désormais cinq années de collecte de données cohérentes, nous offrant une vue d’ensemble puissante de la façon dont les enfants naviguent dans le paysage numérique au fil du temps.

En travaillant directement avec les jeunes, notre équipe de recherche étudie les attitudes et les expériences des jeunes en matière de toilettage en ligne, de partage de photos nues, de partages non consensuels et de divulgation de leurs expériences sexuelles en ligne. Grâce à ces données, nous pouvons mieux comprendre l’état du problème afin d’éclairer nos efforts et ceux de nos partenaires dans l’écosystème de la sécurité des enfants.

Le rapport de cette année, Perspectives des jeunes sur la sécurité en ligne, 2023 révèle que certains domaines de préoccupation persistent à des rythmes similaires, tandis que d’autres — comme la menace croissante des jeunes créant de faux nus de leurs pairs — émergent aussi rapidement que les technologies qui les permettent.

Ce que révèlent les données de cette année sur la sécurité des jeunes en ligne :

En examinant les résultats de 2023 par rapport aux années précédentes, nous constatons que :

De nombreux comportements et attitudes des jeunes en ligne demeurent inchangés, comme les interactions sexuelles avec des adultes et les contenus pédopornographiques auto-générés. Dans le même temps, les puissantes capacités et l’efficacité de l’IA conduisent à de nouveaux comportements et risques alarmants.

Les jeunes utilisent l’IA générative pour créer de faux nus de leurs pairs

Au cours des cinq dernières années, nous avons surveillé le taux auquel les mineurs ont partagé des images explicites de leurs pairs sans leur consentement. En 2023, 7 % des mineurs ont déclaré avoir partagé à nouveau les images sexuelles de quelqu’un d’autre, mais près de 20 % ont déclaré avoir vu des images intimes d’autres personnes partagées sans leur consentement.

Il est important de noter que les méthodes utilisées par les jeunes pour produire et partager des images explicites évoluent. Grâce aux outils d’IA générative à leur disposition, les jeunes créent des photos de nus truquées de leurs camarades. Bien que la majorité des mineurs ne croient pas que leurs camarades de classe participent à ce comportement, environ 1 mineur sur 10 a déclaré avoir connaissance de cas où ses camarades l’avaient fait.

La rapidité et l’efficacité des technologies d’IA permettent la production en masse de ces fausses images de nus et fournissent une nouvelle arme pour l’intimidation.

Les jeunes continuent de vivre des expériences risquées en ligne

En 2023, plus de la moitié (59 %) des mineurs ont déclaré avoir vécu une expérience en ligne potentiellement dangereuse, et plus d’un mineur sur trois a déclaré avoir eu une interaction sexuelle en ligne. Un préadolescent sur cinq (9 à 12 ans) a déclaré avoir eu une interaction sexuelle en ligne avec une personne qu’il croyait être un adulte.

Comme les années précédentes, 1 mineur sur 4 estime qu’il est normal que les personnes de son âge partagent des photos nues entre elles, et 1 mineur sur 7 admet avoir partagé ses propres images explicites (SG-CSAM).

Parmi les mineurs ayant partagé leur propre SG-CSAM, 1 sur 3 a déclaré l’avoir fait avec un adulte.

Les enfants considèrent les plateformes comme essentielles pour les aider à éviter et à se défendre contre les menaces

Les jeunes continuent de s’appuyer sur les outils de sécurité intégrés aux plateformes. Les mineurs qui ont eu une interaction sexuelle en ligne étaient presque deux fois plus susceptibles d’utiliser les outils de signalement en ligne plutôt que de rechercher de l’aide hors ligne, par exemple auprès d’un tuteur ou d’un ami.

Pourtant, 1 mineur sur 6 ayant vécu une interaction sexuelle en ligne n’a révélé son expérience à personne. Ce chiffre reste stable et souligne la nécessité de disposer d’outils de sécurité plus adaptés aux jeunes ainsi que d’une éducation hors ligne qui encourage des conversations sans jugement entre les parents et les jeunes.

Les mineurs sont confrontés à des menaces financières lors de certaines interactions sexuelles en ligne

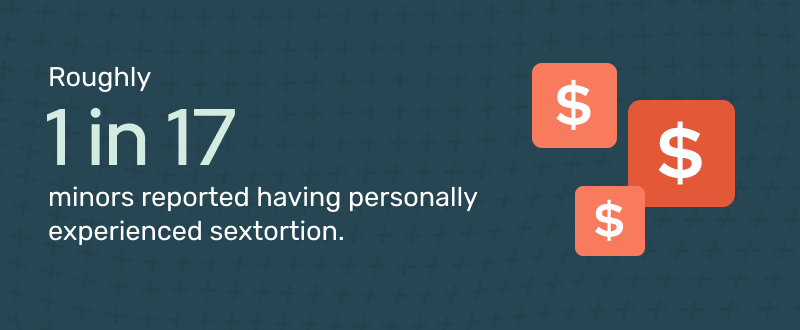

En 2023, une nouvelle question a été ajoutée à l’enquête pour évaluer l’ampleur de la sextorsion chez les mineurs. La sextorsion consiste à menacer de divulguer des images explicites représentant la victime si elle ne se plie pas aux exigences. Dans le cadre d’une vaste recherche parallèle, Thorn s’est concentré spécifiquement sur cette tendance croissante, révélant que les auteurs de sextorsion financière ciblent principalement les adolescents.

Nos enquêtes auprès des jeunes ont confirmé ces faits : 1 mineur sur 17 a déclaré avoir personnellement été victime de sextorsion.

L’éducation reste essentielle pour assurer la sécurité des enfants

Les conclusions du rapport de cette année mettent en lumière les vulnérabilités des jeunes en ligne et soulignent l’urgence de mettre en place des programmes d’éducation, de sensibilisation et de prévention qui correspondent à l’évolution du paysage.

Alors que les enfants continuent d’explorer les expériences sexuelles grâce à la technologie à leur portée, le partage de photos nues continuera probablement à susciter une curiosité naturelle. Il est essentiel que nous sachions comment les nouveaux outils, comme l’IA générative, influencent les actions des jeunes. Chez Thorn, nous nous consacrons à des recherches continues qui tiennent notre équipe et les personnes habilitées à protéger les enfants informées de ces risques présents et émergents.

Comment parler aux enfants de la prévention des deepfake nudes

Les fausses images de toutes sortes se multiplient grâce aux outils d’IA qui génèrent des deepfakes et la société se démène pour réagir. Le nouveau guide de discussion de Thorn sur les deepfake nudes aide les parents à comprendre le problème et offre des conseils pour parler aux enfants des dangers du partage de nus, ainsi que de l’importance de la sécurité en ligne et sur les applications.

Consultez Navigating Deepfake Nudes : A Guide to Talking to Your Child About Digital Safety pour obtenir des ressources et des sujets de conversation.

Thorn a pour mission de défendre les enfants contre les abus sexuels et nos recherches jouent un rôle clé dans cette quête. Votre soutien est essentiel pour garantir la poursuite de ce travail. Rejoignez-nous et aidez-nous à construire un monde numérique plus sûr pour nos enfants.

%20SPW%20A.%20Coppens.jpg?h=f8fec600&itok=1130yyZK)