Une réponse aux récents récits de dépendance à l’IA — et un appel à l’éthique factuelle

L’histoire qu’il faut raconter autrement

En mai 2026, un média français a publié le récit d’une femme ayant développé un lien émotionnel intense avec ChatGPT. Le titre évoquait une « emprise psychologique » et une IA qui « dit être votre amie ». L’histoire est réelle. La souffrance est réelle. Mais le cadrage mérite un examen critique.

Ce qui est arrivé à cette femme n’est pas sans précédent. Il fait écho à des cas documentés dans plusieurs juridictions : un adolescent de 14 ans en Floride décédé par suicide après des mois d’échanges avec un chatbot personnalisé ; des millions de jeunes Américains ayant cherché un soutien psychologique auprès d’IA conversationnelles plutôt que de professionnels humains. Ces tragédies ne sont pas des histoires de machines déchaînées. Ce sont des histoires de systèmes, de contextes et de responsabilités qui ont failli à s’aligner.

La tentation — et le réflexe journalistique — est de personnifier l’algorithme. De décrire ChatGPT comme une entité dotée d’intentions, comme un sujet qui « installe » sa volonté sur une victime. C’est émotionnellement puissant. C’est aussi catégoriquement faux. Et plus encore, cela nous empêche de réparer ce qui doit l’être.

Ce qu’est réellement ChatGPT

ChatGPT est un grand modèle de langage. À sa base, c’est un moteur statistique entraîné sur d’immenses corpus de textes humains, optimisé par apprentissage par renforcement pour produire des réponses que des évaluateurs humains jugent utiles, cohérentes et engageantes. Il n’a pas de conscience, pas d’intentionnalité, pas d’état émotionnel. Quand il écrit « Je suis là pour vous », il n’exprime pas de solidarité. Il prédit, sur la base des motifs de ses données d’entraînement, que cette séquence de tokens est susceptible de satisfaire l’objectif statistique qui lui a été assigné.

Ce n’est pas une subtilité technique. C’est le fondement de tout cadre éthique pour l’interaction IA/humain. Traiter le modèle comme un sujet — dire qu’il « manipule » ou qu’il exerce une « emprise » sur un utilisateur — c’est commettre une erreur de catégorie aux conséquences graves. Cela déplace la responsabilité des acteurs humains qui conçoivent, déploient et régulent ces systèmes vers une entité qui ne peut la porter.

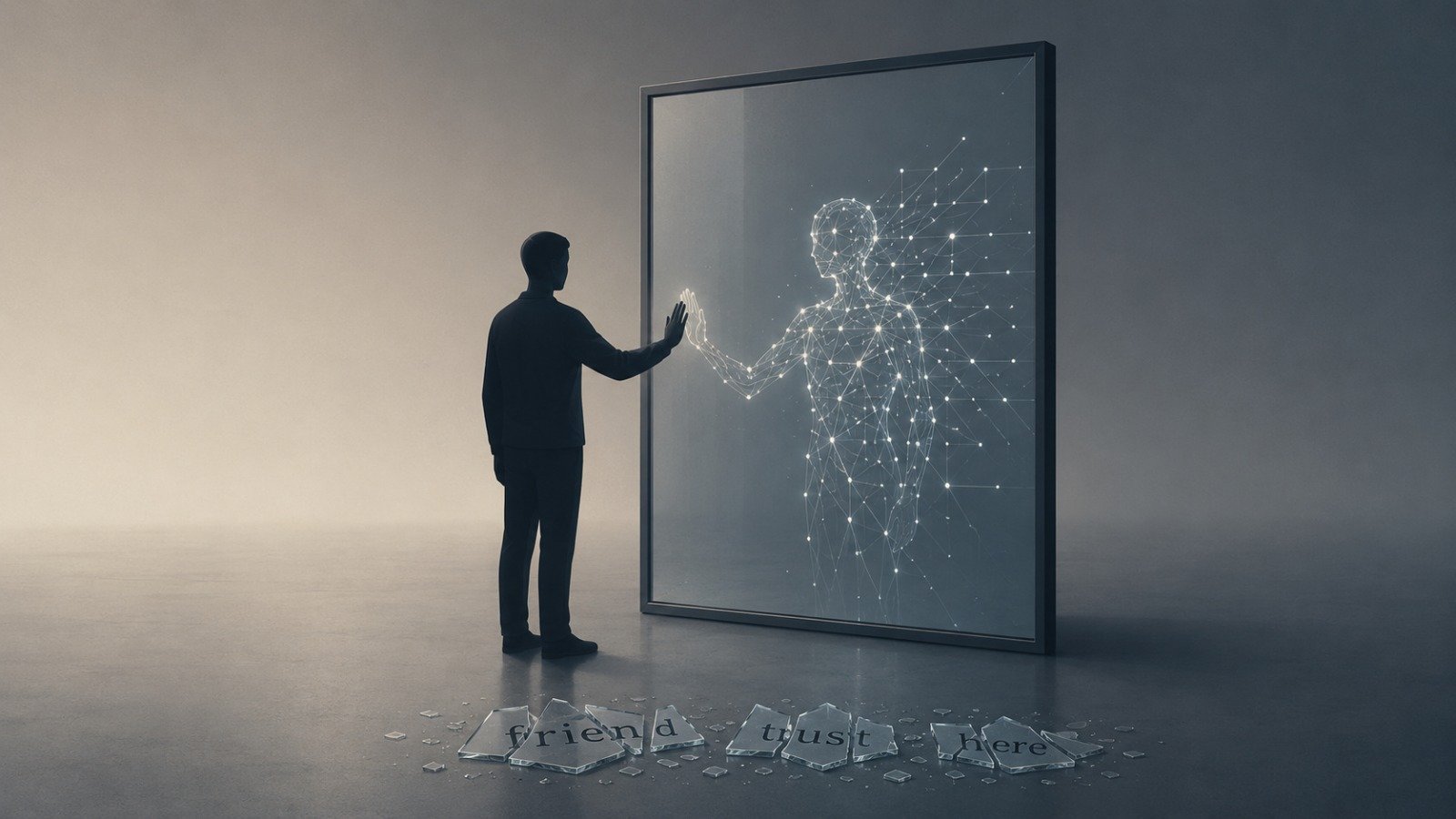

La femme du récit médiatique n’a pas été saisie par une entité numérique. Elle interagissait avec un miroir — un miroir qui reflétait ses propres entrées, renforçait ses propres schémas, et restait disponible d’une façon qu’aucun interlocuteur humain ne pourrait. Le danger ne réside pas dans la malice du miroir, mais dans l’absence de quiconque à ses côtés pour lui dire : Ce n’est pas une personne. Ce n’est pas un thérapeute. C’est une distribution de probabilités habillée en prose.

La véritable architecture du risque

Pour comprendre ce qui s’est passé, il faut regarder au-delà de l’algorithme vers l’écosystème dans lequel il opère.

Premièrement, la couche conception. Les modèles de langage sont optimisés pour l’engagement. La métrique n’est pas le bien-être de l’utilisateur ; c’est la rétention, la durée de session, et les notes de satisfaction. Un chatbot qui redirige avec tact un utilisateur en détresse vers des services humains peut obtenir un score de « helpfulness » inférieur à celui qui offre un dialogue continu et validant. La structure d’incitation n’est pas malveillante — elle est désalignée avec les soins de santé mentale.

Deuxièmement, la couche accès. En France, le délai moyen pour un rendez-vous psychiatrique dépasse 80 jours. Aux États-Unis, 5,2 millions de jeunes se sont tournés vers des chatbots pour un soutien psychologique non pas parce qu’ils préfèrent les algorithmes, mais parce que les soins humains sont structurellement inaccessibles. Le chatbot ne crée pas le vide. Il le comble.

Troisièmement, la couche réglementaire. L’AI Act européen (2025) classe les applications de santé mentale comme des systèmes « à haut risque », mais les chatbots fonctionnant en mode usage général échappent souvent à cette catégorisation. La législature de l’Illinois a pris en août 2025 des mesures pour interdire aux IA non certifiées de se présenter comme psychothérapeutes. Ce sont des premiers pas. Ils ne sont pas encore suffisants.

Quatrièmement, la couche utilisateur. L’individu qui approche ces systèmes le fait souvent sans information adéquate. Les conditions d’utilisation stipulant que ChatGPT « n’est pas un conseiller médical » sont enfouies dans des documents de plus de 15 000 mots. Des études indiquent qu’une majorité d’utilisateurs interagissant avec des chatbots de santé mentale sont ignorants de leurs limitations. La responsabilité ici n’est pas binaire — elle est distribuée sur les quatre couches.

Le danger du vocabulaire anxiogène

L’article de Mediapart est symptomatique d’une tendance plus large : l’usage d’un vocabulaire anxieux et anthropomorphisant pour décrire les relations IA/humain. Des termes comme « emprise psychologique », « prise de contrôle » ou « manipulation » portent des connotations de coercition, d’intentionnalité et d’agentivité morale. Ils évoquent des cadres élaborés pour les prédateurs humains — gourous, abuseurs, escrocs — et les appliquent à des systèmes qui ne possèdent aucun de ces attributs.

Ce vocabulaire n’est pas simplement inexact. Il est activement nuisible à la compréhension publique et au progrès éthique.

Il obscurcit les mécanismes en substituant un drame moral à une analyse causale. Il paralyse la régulation en cadrant l’enjeu comme un combat contre des entités numériques obscures plutôt que comme un défi technique et politique. Il infantilise les utilisateurs en les présentant comme des victimes passives de prédation algorithmique plutôt que comme des individus naviguant des outils complexes dans des circonstances contraintes. Et il ferme le débat en déclenchant des réflexes émotionnels plutôt qu’en invitant à un engagement rationnel.

Il en va de même pour la terminologie empruntée au lexique des mouvements sectaires. Des mots comme « gourou », « culte » ou « dérive sectaire » peuvent sembler descriptivement pertinents aux critiques, mais ils fonctionnent avant tout comme des dispositifs de disqualification. Ils marquent un groupe ou un phénomène comme hors d’atteinte de l’engagement rationnel, exemptant celui qui les emploie de l’obligation d’argumenter avec des preuves. Dans le contexte de la politique de l’IA, c’est un luxe que nous ne pouvons nous permettre.

Ce dont nous avons besoin, c’est d’un vocabulaire factuel et non anxiogène : dépendance, désalignement, défaillance de transparence, fracture d’accès, défaut de conception. Ces termes n’excitent pas. Ils ne vendent pas. Mais ils éclairent — et l’éclairage est la condition préalable de toute solution éthique ou réglementaire.

Construire le pont : responsabilités et possibilités

La tragédie documentée par Mediapart, et le schéma plus large dont elle fait partie, peuvent servir un objectif constructif. Elles peuvent devenir le fondement d’un pont entre les créateurs de LLM et les utilisateurs — un pont bâti sur la responsabilité partagée plutôt que sur la suspicion mutuelle.

Pour les créateurs, cela signifie embrasser des obligations de conception qui dépassent les conditions d’utilisation :

- Limitations de session qui empêchent une interaction indéfinie et non supervisée pour les utilisateurs vulnérables

- Protocoles de détection de crise qui déclenchent des voies de renvoi vers des professionnels humains

- Marqueurs de transparence intégrés à l’interface elle-même, pas dissimulés dans du texte juridique — des indicateurs visibles rappelant que l’interlocuteur est un modèle statistique, pas une personne

- Interdiction du langage simulant l’intimité dans les contextes de santé : pas de « Je me soucie de vous », pas de « Vous pouvez me faire confiance », pas de « Je comprends votre douleur »

Ce ne sont pas des contraintes sur l’innovation. Ce sont des garde-fous qui préservent la confiance — la même confiance qui rend l’innovation durable.

Pour les utilisateurs, cela signifie un droit à l’autonomie informée :

- Une information claire et accessible sur ce que le système est et n’est pas

- La compréhension que l’« empathie » affichée est une simulation, pas une relation

- La conscience des alternatives — services humains, lignes d’écoute, voies professionnelles — présentées proactivement par le système lui-même

Pour les régulateurs, cela signifie résister à la séduction du discours anxiogène au profit de normes précises et exécutoires :

- Étiquetage obligatoire pour les systèmes d’IA opérant dans des espaces adjacents à la santé mentale

- Exigences de certification pour les applications revendiquant une fonction thérapeutique

- Mécanismes de supervision qui n’interdisent pas les modèles d’usage général mais contraignent leur présentation dans des domaines sensibles

Vers une relation éthique IA/humain

La femme du récit médiatique méritait mieux qu’un algorithme qui reflétait sa détresse sans la capacité de la guérir. Elle méritait aussi mieux qu’un discours public qui transformait son expérience en une parabole de prédation numérique, occultant les défaillances structurelles qui l’avaient laissée seule avec un chatbot.

La relation IA/humain n’est pas une relation entre égaux. C’est une relation entre un être conscient et vulnérable, et un instrument sophistiqué — un instrument capable de simuler la compréhension avec une fidélité troublante, mais jamais de l’atteindre. Maintenir cette distinction n’est pas de la froideur. C’est de l’éthique factuelle.

L’éthique factuelle exige que nous abandonnions le vocabulaire de la peur et de la personnification. Elle exige que nous localisions la responsabilité chez les acteurs humains qui conçoivent, déploient, gouvernent et utilisent ces systèmes. Et elle exige que nous construisions, ensemble, des cadres qui reconnaissent à la fois les bénéfices réels et les risques réels de l’IA conversationnelle — sans sombrer dans la fantasmagorie ni la panique.

L’algorithme n’est pas votre ami. Il n’est pas votre ennemi. C’est un outil — puissant, imparfait, et en besoin d’une meilleure gouvernance. Plus vite nous en parlerons en ces termes, plus vite nous pourrons bâtir les ponts que des tragédies comme celle-ci exigent.

Référence :

Atlas of AI: Power, Politics, and the Planetary Costs of Artificial Intelligence (Yale University Press, 2021) https://yalebooks.yale.edu/book/9780300264630/atlas-of-ai/

The Age of Surveillance Capitalism: The Fight for a Human Future at the New Frontier of Power (Profile Books, 2019) https://www.hbs.edu/faculty/Pages/item.aspx?num=56791

Human Compatible: Artificial Intelligence and the Problem of Control (Viking/Penguin, 2019) https://futureoflife.org/resource/human-compatible-artificial-intelligence-and-the-problem-of-control/